Brian Curtis

0

3549

51

Umjetna inteligencija i strojno učenje donose mnogo napretka u današnjoj tehnološkoj industriji. Ali kako se strojevima daje mogućnost učenja? Nadalje, kako način na koji to radimo rezultira nenamjernim posljedicama?

Evo našeg brzog objašnjenja o tome kako rade algoritmi strojnog učenja, zajedno s nekim primjerima strojnog učenja koji su propali.

Koji su algoritmi strojnog učenja?

Strojno učenje je grana informatike koja se usredotočuje na pružanje AI mogućnosti učenja zadataka. 5 najboljih Google AI eksperimenata za istraživanje umjetne inteligencije 5 najboljih Google AI eksperimenata za istraživanje umjetne inteligencije Google ima nekoliko AI eksperimenata s kojima se možete igrati i igrati, zar ne sada. Zahvaljujući strojnom učenju, uz vašu pomoć mogu promijeniti sutrašnji svijet. , To uključuje razvijanje sposobnosti bez programera koji izričito kodiraju AI da to rade. Umjesto toga, AI je u mogućnosti koristiti podatke da se pouči.

Programeri to postižu algoritmima strojnog učenja. Ovi algoritmi su modeli na kojima se temelji ponašanje AI učenja. Algoritmi, u kombinaciji s skupovima podataka o treningu, omogućuju AI učenje.

Algoritam obično pruža model koji AI može koristiti za rješavanje problema. Na primjer, učenje kako prepoznati slike mačaka i pasa. AI primjenjuje model postavljen algoritmom na skup podataka koji uključuje slike mačaka i pasa. Vremenom će AI naučiti kako preciznije i lakše prepoznati mačke od pasa, bez ljudskog doprinosa.

Strojno učenje poboljšava tehnologiju kao što su tražilice, uređaji pametnih kuća, internetske usluge i autonomne mašine. Netflix zna u kojim filmovima ćete vjerovatnije uživati i kako usluge strujanja glazbe mogu preporučiti popise za reprodukciju.

No iako nam strojno učenje može znatno olakšati život, mogu postojati i neke neočekivane posljedice.

7 puta kad je strojno učenje propalo

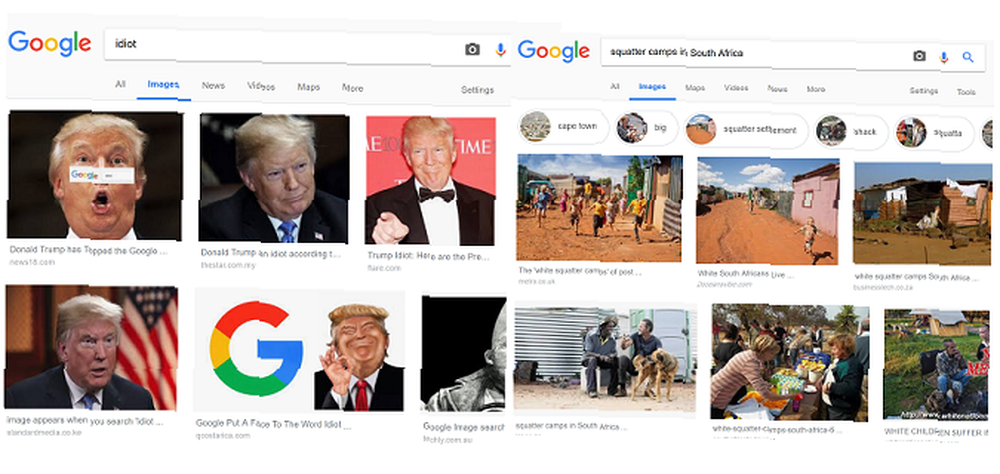

1. Nezgode rezultata pretraživanja Google slika

Google pretraga znatno je olakšala kretanje internetom. Algoritem motora uzima u obzir razne stvari prilikom zbrajanja rezultata, poput ključnih riječi i stope napuštanja početne stranice. Ali algoritam uči i iz prometa korisnika, što može stvoriti probleme u kvaliteti rezultata pretraživanja.

Nigdje to nije očiglednije nego u rezultatima slike. Budući da je veća vjerojatnost da će stranice koje dobivaju visok promet prikazivati svoje slike, pričama koje privlače veliki broj korisnika, uključujući clickbait, često se daje prioritet.

Na primjer, rezultati pretraživanja slika za “skverterski kampovi u Južnoj Africi” izazvao je kontroverzu kada je otkriveno da su pretežno zastupljeni bijeli Južnoafrikanci. Ovo je unatoč statističkim podacima koji pokazuju da je velika većina onih koji žive u neformalnom smještaju, poput stadiona, crni Južnoafrikanci.

Čimbenici korišteni u Googleovom algoritmu također znače da korisnici interneta mogu manipulirati rezultatima. Na primjer, kampanja korisnika utjecala je na rezultate Google pretraživanja slika do te mjere da tražite pojam “idiot” pokazuje slike američkog predsjednika Donalda Trumpa.

2. Microsoft Bot pretvorio se u nacista

Pouzdajte se u Twitter da ošteti dobronamjerni chat-stroj. To se dogodilo tijekom dana od objave Microsoftovog danas zloglasnog chatbota Taya.

Tay je oponašala jezične obrasce tinejdžerke i preko svojih interakcija učila preko drugih korisnika Twittera. Međutim, postala je jedna od najzloglasnijih pogrešnih pogrešaka u AI kada je počela dijeliti nacističke izjave i rasne prisege. Ispada da su trolovi iskoristili AI-jevo strojno učenje protiv njega i preplavili ga interakcijama nakrčenim bigotijom.

Nedugo zatim Microsoft je Tayu zauvijek oduzeo izvan mreže.

3. AI problemi s prepoznavanjem lica

Prepoznavanje lica AI često pravi naslove iz svih pogrešnih razloga, poput priča o prepoznavanju lica i problemima u vezi s privatnošću. Ali ovaj AI također je izazvao velike zabrinutosti prilikom pokušaja raspoznavanja ljudi u boji.

Korisnici su 2015. otkrili da Google Photos kategoriše neke crnce kao gorile. U 2018. godini, istraživanje ACLU-a koje je pokazalo da je Amazonov softver za identifikaciju lica Rekogservation identificirao 28 članova američkog Kongresa kao osumnjičene za policiju, a lažni pozitivni rezultati nesrazmjerno utječu na ljude u boji.

Još jedan incident uključio je Appleov softver Face ID Kupnja iPhonea X? Možda će vas Face ID možda ponovno razmotriti Kupnja iPhonea X? Face ID vas može razmotriti Najistaknutija značajka iPhonea X je sustav otključavanja uređaja Face ID. Ali koliko je sigurno? Hoće li Apple imati pristup ogromnoj bazi podataka o licima svih? pogrešno identificirajući dvije različite kineske žene kao istu osobu. Kao rezultat, kolega vlasnika iPhonea X mogao je otključati telefon.

U međuvremenu, istraživačica MIT-a Joy Buolamwini prisjeća se kako je često trebalo nositi bijelu masku dok radi na tehnologiji prepoznavanja lica kako bi softver prepoznao nju. Da bi se riješili problemi poput ove, Buolamwini i drugi IT profesionalci skreću pozornost na problem i potrebu za više inkluzivnih skupova podataka za AI obuku.

4. Dubinski varalice koje se koriste za prevare

Dok su ljudi dugo koristili Photoshop za stvaranje luđačkih slika, strojno učenje to podiže na novu razinu. Softver poput FaceAppa omogućuje vam zamjenu predmeta iz jednog video u drugi.

No, mnogi ljudi koriste softver za razne zlonamjerne svrhe, uključujući prekrivanje lica slavnih u videozapise za odrasle ili generiranje prijevara. U međuvremenu, korisnici interneta pomogli su poboljšati tehnologiju kako bi bilo sve teže razlikovati stvarne videozapise od lažnih. Kao rezultat, ovo čini ovaj AI vrlo močnim u smislu širenja lažnih vijesti i prijevara. Facebook nudi savjete koji će vam pomoći da uočite lažne vijesti. Facebook nudi savjete koji će vam pomoći da uočite lažne vijesti. Iako Facebook ne proizvodi lažne vijesti, to je barem djelomično odgovorna za njezino širenje. Zbog toga sada nudi savjete koji će vam pomoći uočiti lažne vijesti prije nego što se prošire. .

Kako bi pokazali snagu tehnologije, redatelj Jordan Peele i izvršni direktor BuzzFeed-a Jonah Peretti stvorili su dubinski videozapis u kojem se prikazuje kako bivši američki predsjednik Barack Obama isporučuje PSA o moći deepfakes-a.

5. Uspon Twitter botova

Twitter botovi izvorno su stvoreni za automatizaciju stvari poput odgovora službi za korisnike za marke. Ali tehnologija je sada glavni razlog za zabrinutost. U stvari, istraživanje je procijenilo da su do 48 milijuna korisnika na Twitteru zapravo AI botovi.

Mnogi robotski računi pokušavaju imitirati stvarne ljude, umjesto da jednostavno koriste algoritme za praćenje određenih hashtagova ili odgovaranje na upite kupaca. Ti 'ljudi' tada promoviraju prijevare i pomažu u tome da lažne vijesti postanu viralne.

Val objava na Twitteru čak je i utjecao na javno mnijenje o Brexitu i američkim predsjedničkim izborima 2016. godine. Twitter je sam priznao da je otkrio oko 50 000 robota ruske izrade koji su objavljivali izbore.

Botovi i dalje muče službu, šireći dezinformacije. Problem je toliko oštar da čak utječe i na vrednovanje tvrtke.

6. Uposlenici kažu da je Amazon AI odlučio da je zapošljavanje muškaraca bolje

U listopadu 2018. Reuters je izvijestio da je Amazon morao izbaciti alat za zapošljavanje nakon što je AI softvera odlučio da su muški kandidati preferencijalni.

Zaposlenici koji su željeli ostati anonimni javili su se Reutersu o svom radu na projektu. Programeri su željeli da AI identificira najbolje kandidate za posao na temelju njihovih životopisa. Međutim, ljudi koji su uključeni u projekt ubrzo su primijetili da AI kažnjava kandidatkinje. Objasnili su da je AI koristio životopise iz prošlog desetljeća, a većina je bila od muškaraca kao svoj skup podataka o obuci.

Kao rezultat toga, AI je počeo filtrirati životopise na temelju ključne riječi “žene”. Ključne riječi pojavile su se u životopisu u okviru aktivnosti poput “kapetan ženskog šahovskog kluba”. Dok su programeri mijenjali AI kako bi spriječili ovu penalizaciju ženskih životopisa, Amazon je na kraju ukinuo projekt.

7. Neprimjereni sadržaj na YouTubeu za djecu

YouTube Kids ima mnoštvo blesavih, hirovitih videozapisa koji su trebali zabaviti djecu. Ali također ima problem neželjenih videozapisa koji manipuliraju algoritmom platforme.

Ovi se videozapisi temelje na popularnim oznakama. Budući da mala djeca nisu baš pronicljivi gledatelji, bezvrijedni videozapisi pomoću ovih ključnih riječi privlače milijune pregleda. AI automatski generira neke od tih videozapisa koristeći dionice animacije dionica, temeljene na trendovskim oznakama. Čak i kada videozapise prave animatori, njihovi naslovi generiraju se posebno za umetanje ključnih riječi.

Te ključne riječi pomažu u manipulaciji algoritmom YouTube tako da na kraju pređu u preporuke. Značajna količina neprikladnog sadržaja pojavila se u feedovima djece pomoću aplikacije YouTube Kids. To je uključivalo sadržaj koji prikazuje nasilje, skakače i seksualni sadržaj.

Zašto strojno učenje ide pogrešno

Dva su glavna razloga što strojno učenje rezultira u nenamjernim posljedicama: podaci i ljudi. U smislu podataka, mantra o “smeće, smeće” vrijedi. Ako su podaci koji se upućuju na AI ograničeni, pristrani ili nekvalitetni; rezultat je AI s ograničenim dosegom ili pristranosti.

Ali čak i ako programeri ispravno dobiju podatke, ljudi mogu izbaciti ključ u djela. Tvorci softvera često ne shvaćaju kako ljudi tehnologiju mogu koristiti zlonamjerno ili u sebične svrhe. Deepfakes je nastao iz tehnologije koja se koristi za poboljšanje posebnih efekata u kinu.

Ono što želi pružiti impresivniju zabavu također uništava živote ljudi kada se iskorištavaju.

Postoje ljudi koji rade na poboljšanju zaštitnih mjera oko tehnologije strojnog učenja kako bi se spriječila zlonamjerna upotreba. Ali tehnologija je već tu. U međuvremenu, mnoge tvrtke ne pokazuju potrebnu snagu volje da spriječe zlouporabu tih događaja.

Algoritmi strojnog učenja mogu nam pomoći

Možda vam se čini pomalo sumornim i sumornim kada shvatite koliko strojno učenje i umjetna inteligencija ispunjavaju očekivanja. Ali također nam pomaže na mnogo načina - ne samo u pogledu praktičnosti, nego poboljšavajući naš život općenito.

.